Unsere vernetzte Welt verstehen

Von der Theorie zur Praxis und zurück: Eine Reise durch Public Interest AI

In unserer Forschungsgruppe für gemeinwohlorientierte KI verfolgen wir nicht nur einen theoretischen Ansatz, sondern auch einen praktischen, indem wir technische Prototypen entwickeln. Einer davon ist Simba, unser Tool zur automatischen Vereinfachung von deutschsprachigen Texten im Internet. In diesem Blogbeitrag reflektieren wir unsere anfänglichen Überlegungen zur Public Interest AI anhand unserer Erfahrungen bei der Entwicklung von Simba.

Was ist was

Simba umfasst zwei KI-unterstützte Angebote, die Menschen helfen, deutschsprachige Online-Texte besser zu verstehen. Das erste ist eine Internet-App, mit der eigene Texte vereinfacht werden können. Das andere ist eine Internet-Browser-Erweiterung, die automatisch Texte auf Webseiten zusammenfasst. Beide verwenden ein KI-basiertes Sprachmodell, um deutschsprachige Texte automatisch zu vereinfachen.

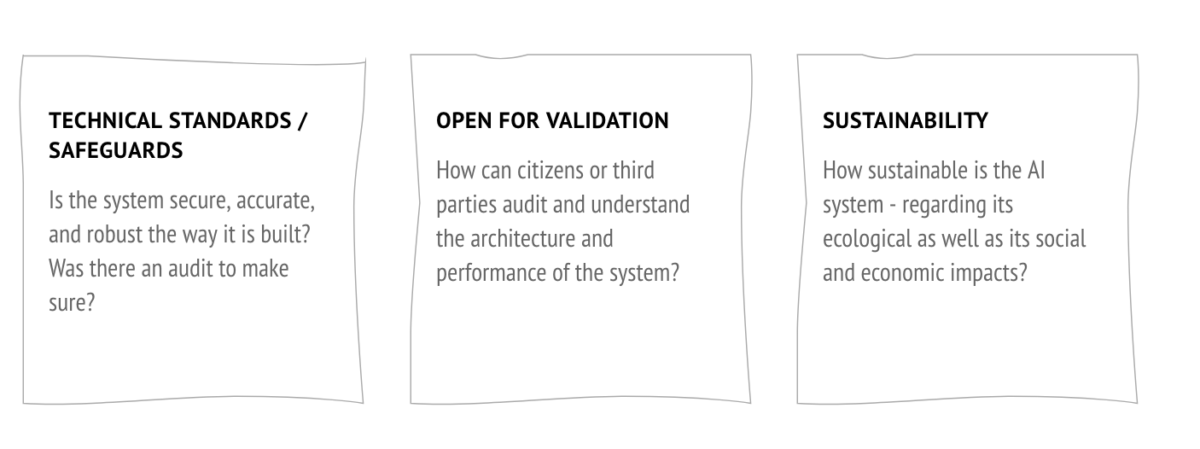

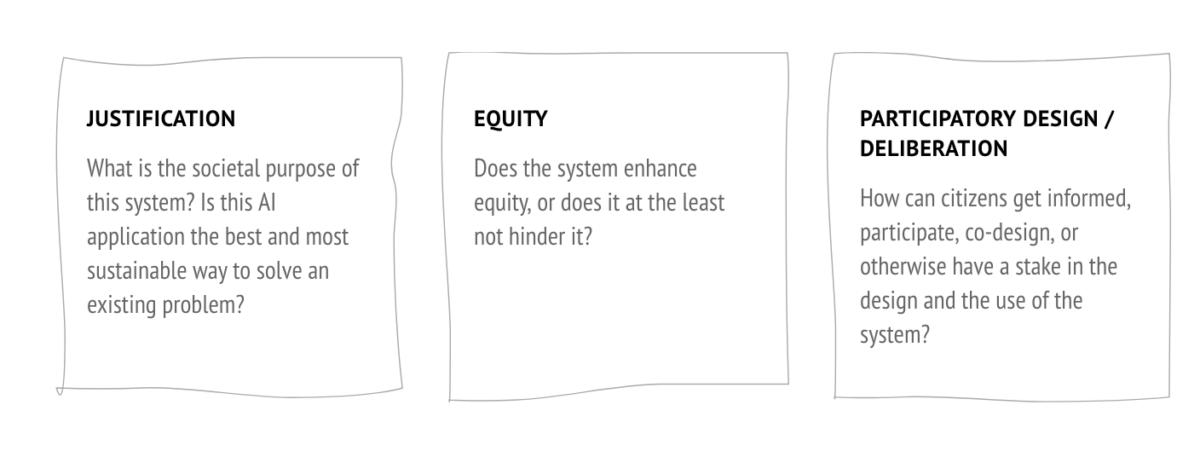

Vereinfachung bedeutet, die Komplexität zu reduzieren, während die Kernbotschaft erhalten bleibt. Dabei werden längere Wörter durch kürzere Synonyme ersetzt, Sätze verkürzt oder zusätzliche Informationen eingefügt, um Zusammenhänge aufzuzeigen und zu erklären. Wir haben Simba im Rahmen unserer sechs Prinzipien der gemeinwohlorientierten KI entwickelt. Diese Grundsätze wurden zu Beginn unseres Forschungsprojekts formuliert und umfassen die Kriterien „Rechtfertigung“, „Gerechtigkeit“, „partizipative Gestaltung/Beratung“, „technische Standards/Garantien“, „offen für Validierung“ und „Nachhaltigkeit“, die in der nachstehenden Abbildung näher erläutert werden.

Aber zuerst: Warum?

„Warum“ ist eine wichtige Frage im Kontext der gemeinwohlorientierten KI, die sich in den Prinzipien von „Rechtfertigung“ und „Gerechtigkeit“ widerspiegelt. Erfüllt Simba einen gesellschaftlichen Zweck, der dem Gerechtigkeitsprinzip nicht widerspricht?

Der „gesellschaftliche Zweck“ der vereinfachten Sprache besteht darin, so vielen unterschiedlichen Menschen wie möglich den Zugang zu Informationen zu ermöglichen. Laut der LEO-Studie, die 2018 von der Universität Hamburg durchgeführt wurde, haben etwa 12 % der deutschsprachigen Erwachsenen in Deutschland geringe Lese- und Schreibfähigkeiten. Das bedeutet, dass sie höchstens in der Lage sind, einfache Sätze zu lesen und zu schreiben. Die Zielgruppen der vereinfachten Sprache reichen von Menschen mit kognitiven Beeinträchtigungen über Nicht-Muttersprachler*innen, Deutschlernende, bis hin zu Kindern. Während wir weiterhin der Meinung sind, dass bestimmte Prozesse selbst systematisch vereinfacht werden könnten – insbesondere im bürokratischen Kontext – glauben wir, dass die Bereitstellung möglichst vieler Informationen in vereinfachter Sprache für eine demokratische Gesellschaft vorteilhaft ist und zur Förderung der Gerechtigkeit beiträgt.

Ein KI-basiertes Tool könnte die Effizienz verbessern und Übersetzer*innen dabei unterstützen, ein breiteres Spektrum an vereinfachten Informationen bereitzustellen. Insbesondere im wissenschaftlichen Bereich. Unsere Recherchen haben ergeben, dass besonders Webseiten öffentlicher Verwaltungen, im Bildungssektor sowie in der Wissenschaft durch ihre komplizierten Formulierungen häufig einen wesentlichen Teil der Bevölkerung von wichtigen Informationen ausschließen.

Technisch werden

Die Entwicklung von KI-basierten Anwendungen erfordert technisches Wissen: Nicht nur für ihren Erfolg, sondern auch um sicherzustellen, dass keine unnötigen Risiken entstehen und keine Ressourcen (wie Zeit und Geld) verschwendet werden. Diese Punkte spiegeln sich in der Bedingung der „technischen Standards“ wider. Als kleines Team sind wir auf die Technologie anderer Akteur*innen angewiesen – Simba basiert auf einem großen Sprachmodell von Meta namens Llama-3. Das Modell ist auf HuggingFace, einer Plattform, die Sprachmodelle hostet, verfügbar und wird oft als Open-Weight-Modell bezeichnet. Zwar sind die Trainingsdaten oder der Prozess nicht vollständig dokumentiert, aber das Modell selbst ist offen verfügbar. Obwohl die Verwendung eines vollständig offenen Modells ideal wäre, ist Llama-3 hocheffizient und liefert im Vergleich zu anderen von uns getesteten Modellen qualitativ hochwertige Ergebnisse. Wir haben unsere eigenen Datensätze verwendet, um Llama-3 weiter zu trainieren. Die Datensätze bestehen aus Ausgangstexte und den dazugehörigen vereinfachten Versionen. Das Modell wird damit besser an diese spezifische Aufgabe angepasst. Mit der Bedingung der „Nachhaltigkeit“ im Hinterkopf haben wir effiziente Fine-Tuning Techniken verwendet, die zu geringeren CO2-Emissionen führen. Schließlich haben wir eine interne Bewertung mit den Mitgliedern des Teams durchgeführt, um faire Arbeitsbedingungen zu gewährleisten.

Offene Validierung und Beratung

Unser Ansatz und Denkprozess bei Simba sind transparent, wie durch Blogbeiträge wie diesen und bevorstehende Forschungspapiere deutlich wird. Darüber hinaus ist unser Code auf GitHub frei verfügbar. Zudem sind unsere Modelle auf HuggingFace zugänglich, ein Teil unserer Trainingsdaten ist dokumentiert und ebenfalls öffentlich verfügbar, und unsere Webseite ist für die Öffentlichkeit zugänglich. Auf letzterer versuchen wir insbesondere, Informationen über Simba für ein weniger technisch versiertes Publikum anzupassen. Wir haben das Projekt begonnen, indem wir die vorhandene Literatur konsultierten, Expert*innen befragten und eine erste Rücksprache mit potenziellen Interessengruppen durchführten – einer Gruppe von Forscher*innen, die Erfahrung mit Behinderung und Diskriminierung haben. Wir bitten auch ausdrücklich um Feedback und ermutigen andere Forscher*innen, Fachleute und engagierte Nutzer*innen aus der Welt der Vereinfachung, mit uns zusammenzuarbeiten und Simba zu verbessern. Bisher haben wir Gedanken und Ideen mit verschiedenen Organisationen und potenziellen Nutzer*innen ausgetauscht. Wir glauben, dass nur durch Zusammenarbeit ein Tool entstehen kann, das für möglichst viele verschiedene Menschen funktioniert.

Die Offenheit von Simba – einschließlich auf verschiedene Zielgruppen zugeschnittener Erklärungen – erfüllt eine notwendige Voraussetzung für die Teilnahme und Beratung. Wir schlagen jedoch vor, dass eine weitere Differenzierung dieser Art des Public Interest AI-Projekts notwendig ist. Diese Differenzierung sollte sich darauf konzentrieren, die Bedingungen in unterschiedlichen Kontexten zu berücksichtigen, insbesondere in Bezug auf die Beteiligung. Projekte, die im öffentlichen Sektor, von mittelgroßen bis großen kommerziellen Unternehmen und kleinen gemeinnützigen Gruppen realisiert werden, verfügen über unterschiedliche Ressourcen und haben möglicherweise unterschiedliche Auswirkungen. Für Simba wäre ein partizipativeres Designverfahren schwierig gewesen, da die Kosten für die Einbeziehung von Interessengruppen hoch sind und die damit verbundene Komplexität im Design erheblich wäre.

Ein starkes Fundament

Insgesamt haben unsere ursprünglichen Überlegungen zur gemeinwohlorientierten KI eine wertvolle Grundlage für das Nachdenken über Künstliche Intelligenz im öffentlichen Interesse geschaffen. Seit dem Beginn des Forschungsprojekts haben wir von einer Vielzahl von Projekten in diesem Bereich gelernt, einschließlich unserer eigenen Prototypen. Unsere Erfahrungen bei der Entwicklung von Simba haben uns gezeigt, dass insbesondere folgende Prinzipien wichtige Faktoren für Public Interest AI Projekte sind: Rechtfertigung, technische Sicherungsmaßnahmen, die Offenheit für Validierung und die Förderung von Zusammenarbeit. Sie gelten unabhängig von der Größe und dem Umfang eines Projekts. Die Prinzipien der Partizipation und Nachhaltigkeit dagegen sollten differenzierter und projektabhängig betrachtet werden.

Simba wurde im Rahmen eines Forschungsprojekts von einem kleinen Team entwickelt. Die Einbeziehung weiterer partizipativer Prozesse wäre aufgrund der Kosten für die Einbindung von Stakeholdern und Nutzer*innen und der Komplexität des (Co-)Designs schwierig gewesen. Zudem wird der Erfolg vieler Forschungsprojekte oft eher durch akademische Veröffentlichungen und weniger durch praktische Ergebnisse gemessen.

Idealerweise könnten langfristig mehr wirtschaftliche Ressourcen und Anreize für praktische Ergebnisse in Forschungskontexten bereitgestellt werden. In der Zwischenzeit hoffen wir, dass diese Dokumentation unserer Erkenntnisse und Erfahrungen Forscher*innen und Entwickler*innen hilft, ihre eigenen gemeinwohlorientierten KI-Projekte besser zu navigieren.

Dieser Beitrag spiegelt die Meinung der Autorinnen und Autoren und weder notwendigerweise noch ausschließlich die Meinung des Institutes wider. Für mehr Informationen zu den Inhalten dieser Beiträge und den assoziierten Forschungsprojekten kontaktieren Sie bitte info@hiig.de

Jetzt anmelden und die neuesten Blogartikel einmal im Monat per Newsletter erhalten.

Künstliche Intelligenz und Gesellschaft

Freundlich, aber distanziert: Die unbeabsichtigten Folgen KI-generierter E-Mails

KI-generierte E-Mails sparen Mitarbeitenden Zeit und erleichtern den Arbeitsalltag. Aber verlieren wir dadurch unsere Kommunikationsfähigkeiten?

KI am Mikrofon: Die Stimme der Zukunft?

Von synthetischen Stimmen bis hin zu automatisch erstellten Podcast-Folgen – KI am Mikrofon revolutioniert die Produktion digitaler Audioinhalte.

Haben Community Notes eine Parteipräferenz?

Dieser Artikel analysiert, ob Community Notes Desinformation eindämmen oder ob ihre Verteilung und Bewertung politische Tendenzen widerspiegeln.