Zines zur Fairness in KI-Systemen: Feels Fair?

Wie stellen wir sicher, dass Künstliche Intelligenz (KI) fairere Entscheidungen trifft? Diese Frage gewinnt zunehmend an Bedeutung, da KI-Systeme immer häufiger in Bereichen wie Personalentscheidungen, der Vergabe von Krediten oder der Bearbeitung von Anträgen auf Sozialleistungen eingesetzt werden. Oft bleibt jedoch unklar, wie faire oder ungerechte Ergebnisse entstehen. Genau hier setzen unsere Zines an: Sie bieten eine verständliche Einführung in die Frage, wie KI-Systeme fairer oder unfair werden können. Dabei richten sie sich an Personen ohne vertiefte technische Vorkenntnisse, setzen jedoch eine erste Auseinandersetzung mit dem Thema KI voraus.

Ob in Schulen, Universitäten oder für die breite Öffentlichkeit – unsere Zines bieten einen klaren und praxisnahen Zugang zu einem komplexen Thema. Sie ermöglichen einen ersten Einstieg in die öffentliche Debatte rund um KI und Fairness.

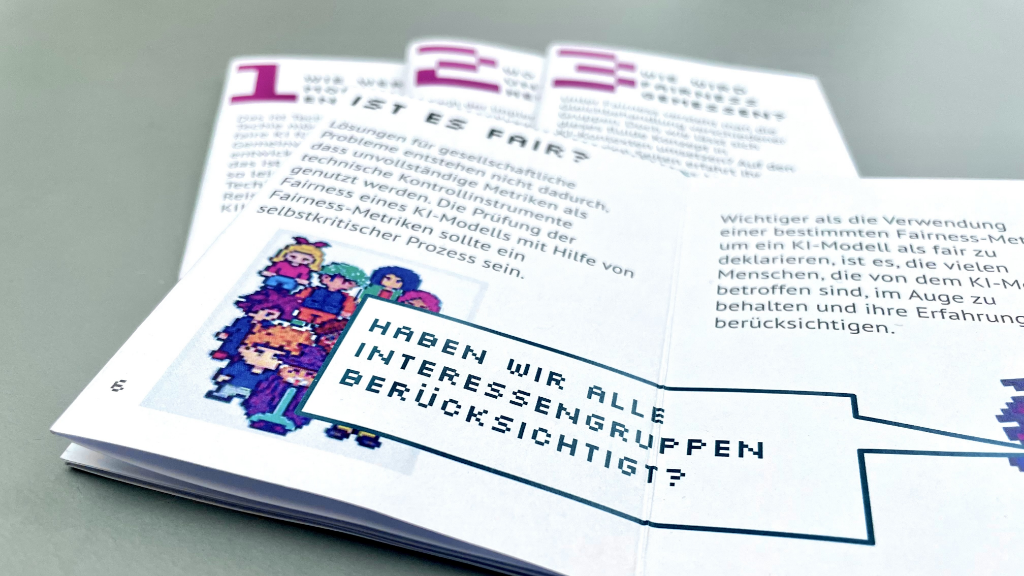

Vier Zines, vier Schritte zu fairer KI

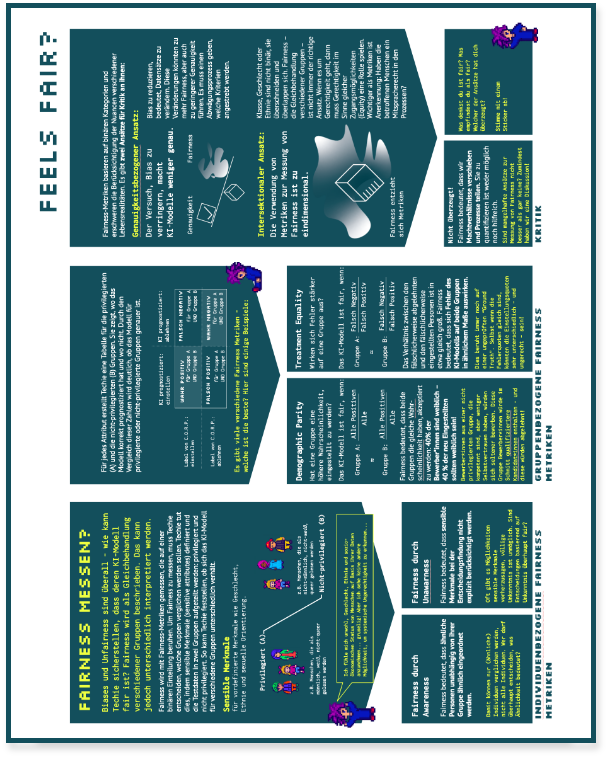

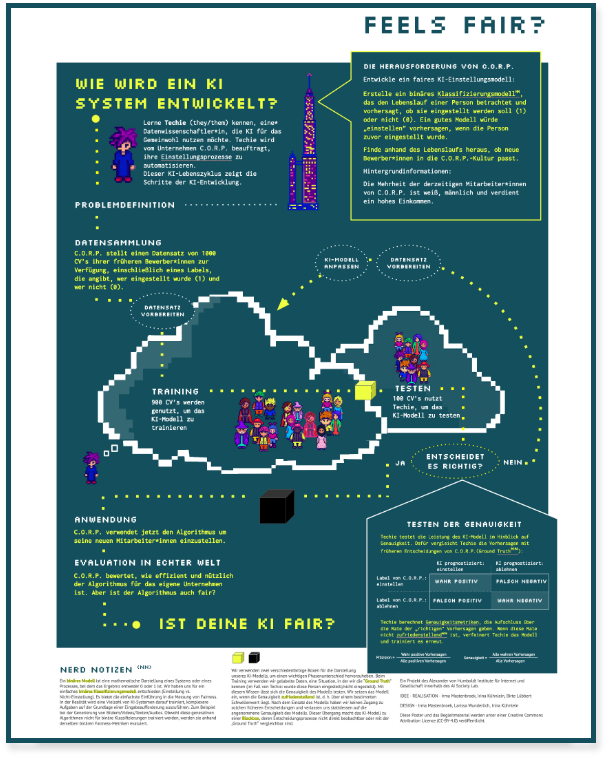

Die einzelnen Zines beleuchten Schritt für Schritt die wichtigsten Aspekte rund um Fairness und KI. In vier Kapiteln begleiten wir Techie, eine*n Data Scientist*, auf deren Weg zu gerechteren KI-Systemen. Die Zines erklären, wie KI-Systeme entwickelt und trainiert werden. Welche Verzerrungen, sogenannte Biases, können die Entscheidung von KI beeinflussen? Und welche mathematischen Methoden zur Messung von Fairness kommen hier zum Einsatz?

Zusätzlich gibt es zwei Poster, die den Prozess der KI-Entwicklung und die Funktionsweise von Fairnessmetriken auf einem größeren Format darstellen. Sie dienen nach dem Durcharbeiten der Zines als Grundlage für Gruppendiskussionen.

Warum Zines?

Zines (ausgesprochen: “Siiines”, wie das Ende von Magazine im Englischen) sind klein. Als Teil der Geschichte von Gegenkultur sind sie oftmals künstlerisch gestaltete, selbst publizierte kleine Formate, die in geringer Auflage gedruckt und gut verteilt werden können. Sie passen in jede Tasche und genau darum sollte es auch gehen, wenn es um die dominanten Diskurse unserer Gesellschaft geht. Wenn wir wollen, dass alle Beteiligten und Betroffenen mitsprechen können, dann muss das nötige Wissen auch für alle zugänglich sein.

Warum ist Fairness in KI-Systemen wichtig?

KI-Systeme sind immer häufiger Teil von Entscheidungsprozessen, die tiefgreifende Auswirkungen auf das Leben der Menschen haben. Daher ist es entscheidend, dass diese Systeme fair agieren und keine bestehenden Ungerechtigkeiten verstärken. Ein oft vorgeschlagener Ansatz ist das sogenannte Debiasing – Techniken, die helfen sollen, Verzerrungen in den Daten oder Algorithmen zu beseitigen. Aber was genau bedeutet das? Wo liegen die Grenzen von Debiasing, und wann ist ein KI-System wirklich fair?

Zielgruppe und Lerneffekte

Unsere Zines sollen ein grundlegendes Verständnis dafür schaffen, wie KI-Systeme entwickelt werden, wie versucht wird, Fairness zu messen und welche Rolle Biases spielen. Nach einer aktiven Auseinandersetzung mit ihnen sind Menschen in der Lage, die Herausforderungen und Grenzen von Fairness in der KI zu verstehen und kritisch zu bewerten. Die Materialien richten sich an Lehrkräfte, Studierende, Fachkräfte im Bereich der KI-Entwicklung sowie politische Entscheidungsträger*innen, die sich mit der Frage beschäftigen, wie gerechtere KI-Systeme in unserer Gesellschaft gestaltet werden können.

AI & Society Lab

Diese Open Educational Resource ist unter der Lizenz Creative Commons Attribution 4.0 Licence veröffentlicht, welche eine freie Verwendung der Materialien unter Angabe des Urhebers ermöglicht.

Die Zines sind doppelseitig konzipiert. Diese Anleitung hilft euch, die Zines zu falten, um aus einem A4 Papier ein lesbares kleines Buch zu machen. Ihr könnt es jederzeit wieder öffnen, um auch die Übersichtsgrafik auf der Rückseite des Papiers zu lesen.

Das HIIG entwickelt kontinuierlich eine breite Palette an OER, darunter eine Redereihe zur digitalen Gesellschaft, einen Werkzeugkasten für Zukunftsdenken und mehrere Spiele.